在檢索增強(qiáng)生成中,擴(kuò)大生成模型規(guī)模往往能提升準(zhǔn)確率,但也會(huì)顯著抬高推理成本與部署門檻。CMU 團(tuán)隊(duì)在固定提示模板、上下文組織方式與證據(jù)預(yù)算,并保持檢索與解碼設(shè)置不變的前提下,系統(tǒng)比較了生成模型規(guī)模與檢索語(yǔ)料規(guī)模的聯(lián)合效應(yīng),發(fā)現(xiàn)擴(kuò)充檢索語(yǔ)料能夠穩(wěn)定增強(qiáng) RAG,并在多項(xiàng)開(kāi)放域問(wèn)答基準(zhǔn)上讓小中型模型在更大語(yǔ)料下達(dá)到甚至超過(guò)更大模型在較小語(yǔ)料下的表現(xiàn),同時(shí)在更高語(yǔ)料規(guī)模處呈現(xiàn)清晰的邊際收益遞減。更進(jìn)一步,研究不僅刻畫了隨語(yǔ)料擴(kuò)容而變化的性能增益,也揭示了若干相對(duì)穩(wěn)定的不變規(guī)律。

在開(kāi)放域問(wèn)答等知識(shí)密集型任務(wù)中,檢索增強(qiáng)生成(RAG)已經(jīng)成為主流范式之一。它通過(guò)先檢索外部文檔,再讓大語(yǔ)言模型基于證據(jù)生成答案,從而緩解純參數(shù)記憶帶來(lái)的幻覺(jué)與事實(shí)錯(cuò)誤。然而,近年來(lái)提升 RAG 的常見(jiàn)路徑往往集中在擴(kuò)大生成模型規(guī)模,準(zhǔn)確率確實(shí)會(huì)上升,但推理成本與部署門檻也隨之顯著提高。對(duì)于希望在有限算力下落地的系統(tǒng)而言,一個(gè)更現(xiàn)實(shí)的問(wèn)題是:在不繼續(xù)擴(kuò)大模型參數(shù)的前提下,是否還有同樣有效的提升空間。

卡內(nèi)基梅隆大學(xué)計(jì)算機(jī)學(xué)院團(tuán)隊(duì)在最新 ECIR 接收論文中給出了一個(gè)清晰的回答。他們把關(guān)注點(diǎn)從更大的模型轉(zhuǎn)向更大的檢索語(yǔ)料,系統(tǒng)評(píng)估了語(yǔ)料規(guī)模與生成模型規(guī)模之間的替代關(guān)系,并提出了可操作的權(quán)衡框架。核心觀點(diǎn)為,擴(kuò)大檢索語(yǔ)料通常可以顯著增強(qiáng) RAG,且在不少設(shè)置下,這種增強(qiáng)效果可以部分替代擴(kuò)大模型參數(shù)帶來(lái)的收益,但在更大語(yǔ)料規(guī)模處會(huì)出現(xiàn)邊際收益遞減。

- 論文標(biāo)題:Less LLM, More Documents: Searching for Improved RAG

- 論文鏈接:https://arxiv.org/pdf/2510.02657

從問(wèn)題出發(fā):RAG 的另一條擴(kuò)展軸

RAG 的效果由兩部分共同決定。檢索模塊負(fù)責(zé)把可能包含答案的證據(jù)送到模型上下文中;生成模型負(fù)責(zé)理解問(wèn)題、整合證據(jù)并形成答案。擴(kuò)大模型參數(shù)能夠提升推理與表達(dá)能力,但檢索端提供的證據(jù)質(zhì)量與覆蓋范圍,往往直接決定模型是否有機(jī)會(huì)看到答案線索。CMU 團(tuán)隊(duì)指出,檢索語(yǔ)料的規(guī)模本身就是一條獨(dú)立的擴(kuò)展軸,但長(zhǎng)期以來(lái)缺少與模型規(guī)模聯(lián)合控制變量的系統(tǒng)研究,因此語(yǔ)料擴(kuò)容能否補(bǔ)償小模型仍缺乏定量結(jié)論。

實(shí)驗(yàn)設(shè)計(jì):只讓兩個(gè)變量變化

為得到可解釋的權(quán)衡曲線,研究采用了全因子設(shè)計(jì),只讓語(yǔ)料規(guī)模與模型規(guī)模變化,其余保持一致。檢索語(yǔ)料選用大規(guī)模搜索引擎數(shù)據(jù)集 ClueWeb22-A 的英文子集,總計(jì)包含約 2.64 億真實(shí)網(wǎng)頁(yè)文檔,并將其隨機(jī)均衡切分為 12 個(gè) shard。語(yǔ)料規(guī)模用激活 shard 的數(shù)量表示,逐步從 1 個(gè) shard 擴(kuò)展到 12 個(gè) shard。檢索端使用 MiniCPM-Embedding-Light 做稠密向量編碼,后端采用 DiskANN 構(gòu)建多 shard 近鄰檢索,固定 top 文檔數(shù)、切塊與重排策略,最終向生成模型提供固定數(shù)量的 top chunk 作為 LLM 答案生成證據(jù)。

生成端選用最新 Qwen3 同一模型家族的不同尺寸,覆蓋從 0.6B 到 14B 的 Qwen3 模型,并固定提示模板與解碼設(shè)置,以確保比較只反映規(guī)模變化帶來(lái)的差異。評(píng)測(cè)任務(wù)覆蓋三個(gè)開(kāi)放域問(wèn)答基準(zhǔn):Natural Questions、TriviaQA 與 Web Questions,指標(biāo)采用最常用的 F1 與 ExactMatch。

關(guān)鍵發(fā)現(xiàn)一:

語(yǔ)料擴(kuò)容可以讓小模型追上大模型(變)

實(shí)驗(yàn)結(jié)果展示了明確的補(bǔ)償效應(yīng)。以 Natural Questions 為例,隨著語(yǔ)料從 1 個(gè) shard 擴(kuò)展到更大規(guī)模,較小模型的 EM 與 F1 持續(xù)提升,并在一定語(yǔ)料規(guī)模后達(dá)到或超過(guò)更大模型在小語(yǔ)料上的基線表現(xiàn)。研究用 n 星指標(biāo)刻畫補(bǔ)償閾值,即小模型需要多少倍語(yǔ)料才能追平大模型在 1 個(gè) shard 下的成績(jī)。在三個(gè)數(shù)據(jù)集上,這一閾值呈現(xiàn)出穩(wěn)定模式:中等規(guī)模模型之間的追平往往只需要把語(yǔ)料擴(kuò)大到 2 倍或 3 倍,而最小模型想追平下一檔模型則需要更高倍數(shù)的語(yǔ)料擴(kuò)容。

更重要的是,這種追平并非個(gè)別現(xiàn)象。研究在 TriviaQA 與 WebQuestions 上觀察到相同趨勢(shì),并給出了跨數(shù)據(jù)集的閾值表,顯示語(yǔ)料擴(kuò)容在多數(shù)設(shè)置下都能把性能缺口縮小到一個(gè)模型檔位,甚至兩個(gè)檔位。對(duì)部署而言,這意味著當(dāng)推理預(yù)算難以支撐更大參數(shù)模型時(shí),把資源投入到更大語(yǔ)料與更強(qiáng)檢索,可能是更務(wù)實(shí)的提效方向。

在增長(zhǎng)形態(tài)上,研究觀察到幾乎與模型規(guī)模無(wú)關(guān)的共同曲線。最顯著的提升發(fā)生在從無(wú)檢索到有檢索的第一步,隨后隨著語(yǔ)料繼續(xù)擴(kuò)大,收益逐步下降,并在約 5 到 6 倍語(yǔ)料規(guī)模附近出現(xiàn)飽和趨勢(shì)。這一現(xiàn)象對(duì)工程實(shí)踐具有直接意義:檢索能力的從無(wú)到有往往帶來(lái)最大增益,但在較高語(yǔ)料規(guī)模處繼續(xù)無(wú)上限擴(kuò)容并不劃算,應(yīng)該結(jié)合吞吐、延遲與存儲(chǔ)成本做更精細(xì)的預(yù)算分配。

關(guān)鍵發(fā)現(xiàn)二:

提升主要來(lái)自證據(jù)覆蓋,而非模型更會(huì)用證據(jù)(不變)

語(yǔ)料變大為什么能帶來(lái)提升?論文給出的機(jī)制解釋相對(duì)直接且符合直覺(jué)預(yù)期:語(yǔ)料擴(kuò)容提高了檢索到含答案片段的概率。當(dāng)語(yǔ)料規(guī)模較小時(shí),檢索到的片段經(jīng)常只與主題相關(guān),但不包含關(guān)鍵事實(shí);隨著語(yǔ)料擴(kuò)大,更容易檢索到明確包含答案字符串的證據(jù)片段,生成模型因此獲得更可靠的落腳點(diǎn)。

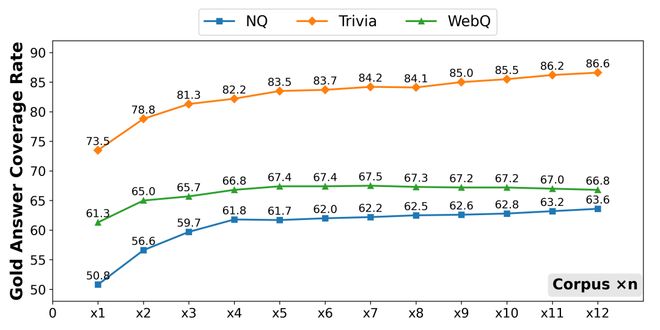

為把這種直覺(jué)量化,研究定義了 Gold Answer Coverage Rate,用于統(tǒng)計(jì)傳入生成模型的 top chunk 中至少有一個(gè)包含標(biāo)準(zhǔn)答案字符串的概率。結(jié)果顯示,覆蓋率隨語(yǔ)料規(guī)模增長(zhǎng)而單調(diào)上升,并在不同數(shù)據(jù)集上體現(xiàn)出差異性,例如 TriviaQA 的覆蓋率整體更高,反映其信息需求與網(wǎng)頁(yè)語(yǔ)料的重合度更強(qiáng)。

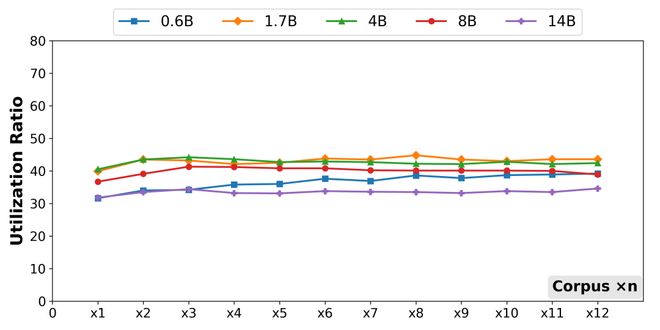

進(jìn)一步地,研究提出 Context Benefited Success Rate,用于衡量那些在無(wú)檢索時(shí)無(wú)法答對(duì)的問(wèn)題,在加入檢索證據(jù)后被答對(duì)的比例,并用 Utilization Ratio 將其與覆蓋率相除,以刻畫模型把可用證據(jù)轉(zhuǎn)化為正確答案的效率。實(shí)驗(yàn)顯示,Utilization Ratio 在不同語(yǔ)料規(guī)模下整體保持穩(wěn)定,且在不同模型尺寸之間差異有限。結(jié)合無(wú)檢索設(shè)置下的基線表現(xiàn)可以看到,不同大小模型的主要差別更多來(lái)自其參數(shù)中可直接調(diào)用的內(nèi)部知識(shí)儲(chǔ)備,使其在無(wú)需外部證據(jù)時(shí)也能回答一部分問(wèn)題;而對(duì)于那些無(wú)法僅憑內(nèi)部知識(shí)答對(duì)的問(wèn)題,一旦檢索端提供了包含答案線索的證據(jù),不同模型將證據(jù)轉(zhuǎn)化為正確答案的效率整體相近。因此,語(yǔ)料擴(kuò)容帶來(lái)的關(guān)鍵收益主要體現(xiàn)在提高含答案證據(jù)進(jìn)入上下文的概率,而非顯著提升模型對(duì)既有上下文的利用能力。

工程啟示:如何在預(yù)算約束下分配投入

綜合實(shí)驗(yàn)結(jié)論,論文給出了一條可執(zhí)行的系統(tǒng)設(shè)計(jì)建議。當(dāng)推理資源受限時(shí),優(yōu)先考慮擴(kuò)大檢索語(yǔ)料與提升覆蓋率,常常能讓中等規(guī)模生成模型達(dá)到接近更大模型的表現(xiàn)。相比之下,極小模型需要更激進(jìn)的語(yǔ)料擴(kuò)容才能追平下一檔,收益效率偏低;而極大模型在更大語(yǔ)料下的增益也相對(duì)有限,體現(xiàn)出利用效率并不會(huì)隨著參數(shù)規(guī)模單調(diào)上升。對(duì)系統(tǒng)優(yōu)化而言,跟蹤答案覆蓋率與利用率可以作為診斷指標(biāo),幫助判斷瓶頸更偏檢索端還是生成端,從而指導(dǎo)下一步應(yīng)該擴(kuò)語(yǔ)料、調(diào)檢索,還是換模型。

結(jié)語(yǔ)

這項(xiàng)研究把 RAG 的規(guī)模討論從單一的模型參數(shù)擴(kuò)展到語(yǔ)料與檢索能力,給出了可復(fù)現(xiàn)的控制變量實(shí)驗(yàn)與清晰的機(jī)制解釋。其結(jié)論可以概括為兩點(diǎn):擴(kuò)大語(yǔ)料通常有效,但收益存在邊際遞減;提升主要來(lái)自更高的答案證據(jù)覆蓋,而非模型利用證據(jù)能力的躍遷。在面向真實(shí)部署的 RAG 系統(tǒng)中,這提供了一條更可控、更具性價(jià)比的提升路徑。